随着AI技术的进步和时间的推移,AI与人类生活的融合度也在不断提升,许多融合了AI的智能硬件,也以多样的形态出现在我们面前。这篇文章里,作者从产品设计理念、产品能力,以及产品交互形态等维度拆解了3款消费级AI设备,一起来看看吧。

见字如面~

文章内容相较于视频内容会更加精简

如需了解更多细节的内容请观看视频,视频地址:https://www.bilibili.com/video/BV1w6421V7k5

引言一年一度的全球消费电子风向标CES 2024已经落下帷幕,展会中展示了很多科技向善的产品。

有专为视障人士设计的导盲眼镜(lumen glasses),能够感知周围障碍物、路标等物体,再通过声音和触觉反馈指引盲人行动。

有辅助步行锻炼的穿戴设备WIM,用户穿戴后可以减少20%的步行能量,适用于肌肉力量不足的老年人。

还有在展会中呼声很高的手持设备,Rabbit-R1。

AI在以各种各样的方式融入我们的生活,也从相对专业的领域,逐步向C端消费市场中落地,文章会以三款消费级AI设备为切入点:Rabbit-R1、AI PIN、Tab AI。

从产品设计理念、产品能力,以及产品交互形态等几方面,向你介绍生成式人工智能与可穿戴设备的融合趋势,希望能够给你带来启发与帮助。

这款产品由华人创始人吕骋所创建,Rabbit-R1绝对是CES展会中的亮点产品之一。首批 1 万台迅速卖光,短短5天时间已经卖了50000多台,一台售价199美元,在预售阶段已经获利近1000万美元。

Rabbit-R1的核心设计理念是“让用户告别繁琐的应用操作”。

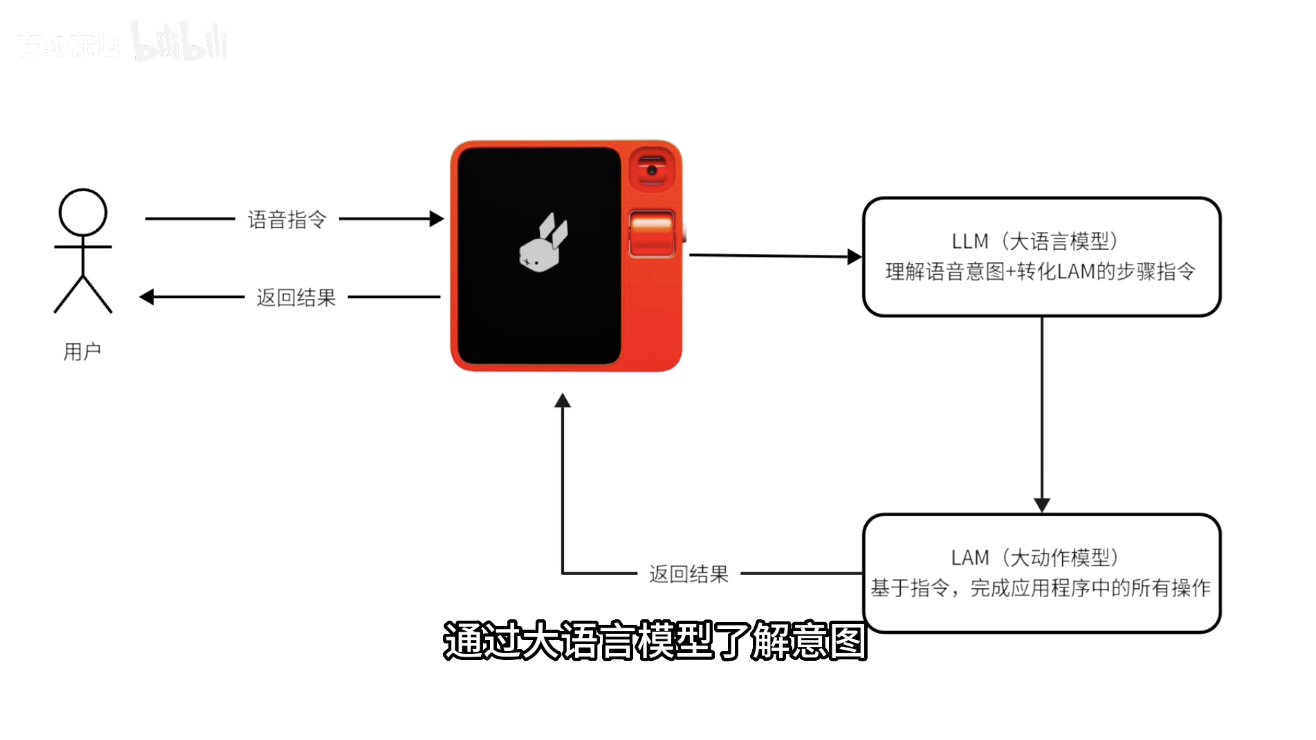

怎么理解呢?好比我们需要订一张旅游机票,有了它无需在应用程序中自己摸索操作,而是通过语音的方式,给设备传达指定,通过LLMs了解意图,再将意图转化为LAM(大动作模型)的指令,从而自动完成应用程序中的所有操作,并将结果呈现给用户进行选择。

R2abbit-R1通体呈亮橙色,其重量约为115克,正面有一块2.88英寸的触摸显示屏。

屏幕右侧上方,是一个能够360° 旋转的AI摄像头,能够执行视觉类的任务,如:物体识别、图像分析。

摄像头下面是操作滚轮,通过滑动滚轮或屏幕,可浏览屏幕中呈现的内容。

侧边有一个圆形按键,是一键唤醒AI的快捷键。

在硬件方面,通过语音交互和拍摄的方式进行信息输入,信息的输出以屏幕显示和语音的方式进行呈现,交互上通过滑动滚轮或屏幕浏览信息。

4. 软件方面Rabbit-R1的操作系统叫做 Rabbit OS,其核心在于操作系统中搭载了「大动作模型」(Large Action Model)。

简单的说LAM能够学习人们操作应用程序(APP)的行为,能够基于文本指令,实现应用程序内的操作步骤,从而完成任务目标。

与LLM的区别在于,LLM-大语言模型学习的是文本语料,从而理解文本语意,生成文本内容。

LAM大动作模型学习的是人们操作应用程序的行为路径,可基于指令完成应用程序操作。

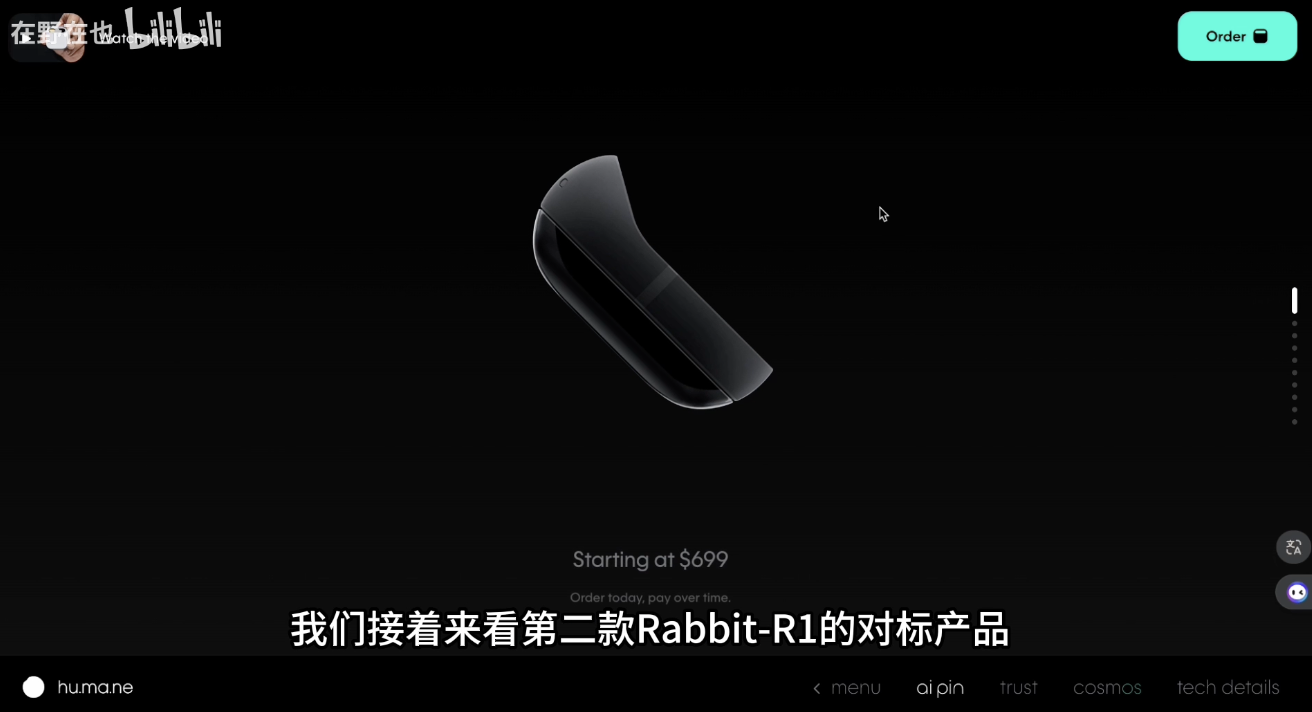

我们接着来看第二款产品。

二、AI-PINAI Pin是初创公司Humane的首个产品,两位创始人均为苹果的前员工。

它是一款可以吸附在衣服上的智能设备,没有屏幕,设备中搭载语音装置和投影仪,可以通过语音、手势、触控等形式与设备进行交互。

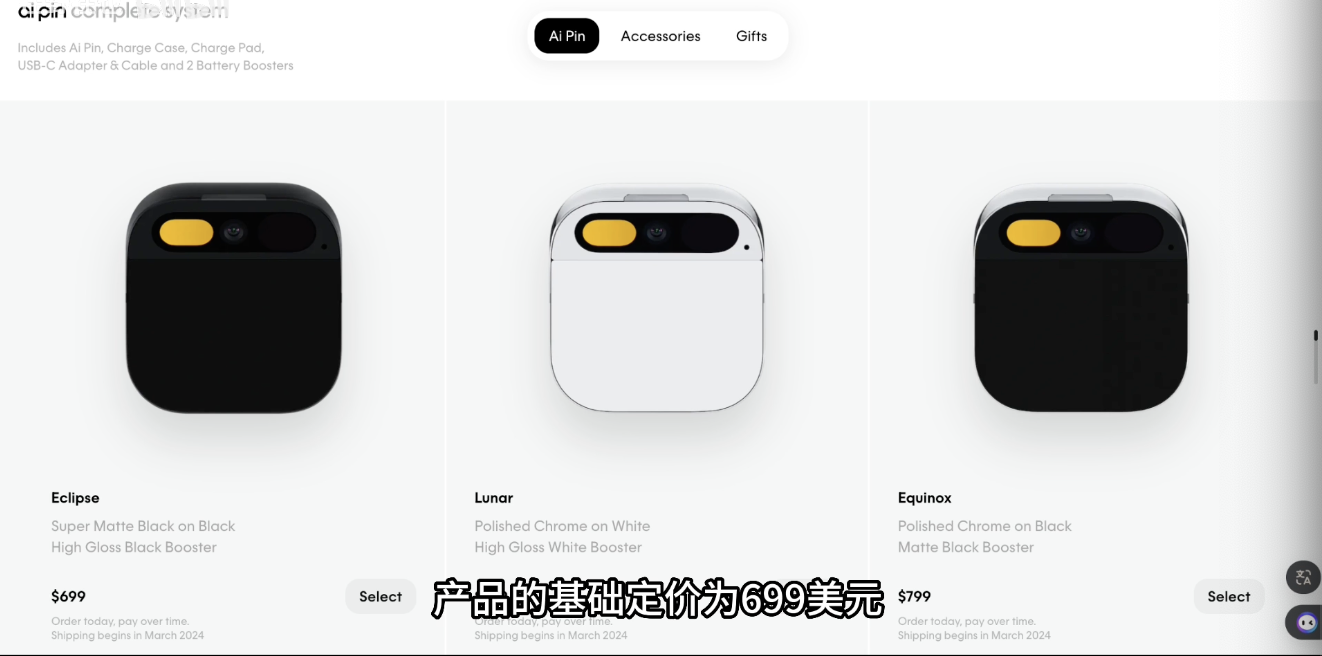

产品的基础定价为699美元,外加24美元的月订阅服务费。

其中订阅服务费的核心服务包括:T-Mobile电话号码和网络服务、照片/视频/文件的云存储服务以及GPT4的无限调用次数。

其目标是减少用户对智能机的依赖,以全新的、无屏幕、可对话的形式,赋予用户随时随地使用AI的能力。

简单的说就是想干掉智能手机,迈入穿戴设备的iPhone时刻。

2. 硬件方面AI Pin由两部分组成:设备和电池,设备与电池之间可通过磁性吸附在衣服上,产品总量为54克,相当于一个鸡蛋的重量。

设备的顶部方搭载了麦克风/扬声器,能够进行音频播放,作为语音信息输入的关键配件。

设备的上方搭载了广角摄像头能够进行拍照、摄影。作为AI信息输入的“眼睛”,能够识别和分析现实中的商品或检测食品的营养成分。

在摄像头的旁边装在了激光投影仪,可将数字信息投影在手掌上,从而实现数字信息的展示与交互。

抬起手掌即可唤醒投影装置;

通过手掌侧移,手指捏合可以实现数据信息的交互。

设备的下方为触控板区域,能够通过手指实现触控交互,如单指点击并按住,可以和AI进行交流;双指双击可进行拍摄,滑动可控制音频的音量等等。

AI PIN操作系统名为Cosmos。

它支持实时访问GPT4,不仅可以对输入的信息(语音或图像)进行处理,也能通过AI帮助我们总结和搜索重要信息,比如:语音输入特定指令:Catch me up 后,AI会将我们日常重要信息进行摘要汇总,也能通过语音指令,让AI检索信息后,直接告诉我们信息内容。

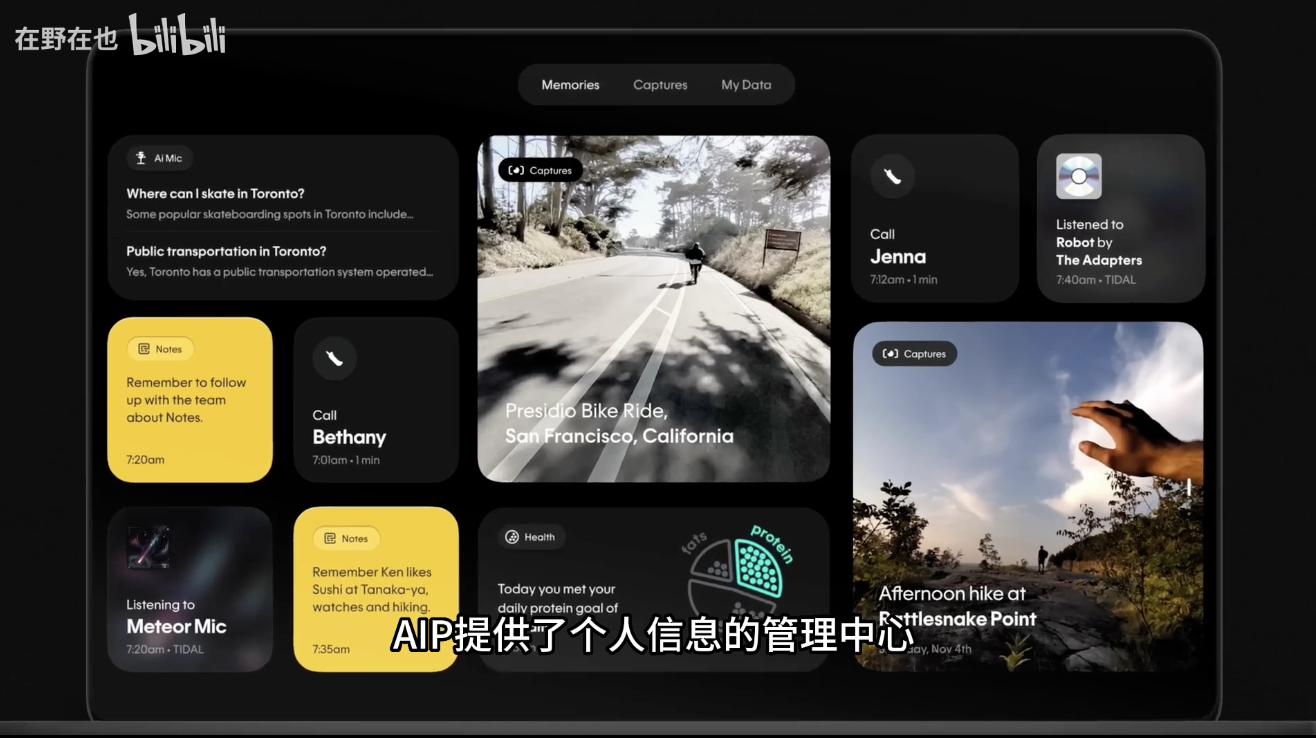

AI PIN提供了个人信息的管理中心,名为:Humane.center。

在Humane.center中,用户可管理自己的数据,包括照片、视频、笔记、邮件、短信等,随着这些信息不断的丰富,AI会更懂用户,成为真正的个人助理。

AI PIN这款产品的出现,无论在外观的工业设计、人机交互方式,还是与生成式人工智能的结合上,都为可穿戴人工智能设备开辟了一条新道路。但是这款产品本身也做不到替代智能手机。

主要分享两个个人观点:

第一,该产品的使用场景受限,语音交互作为AI PIN的主要交互形式,在相对嘈杂环境中会影响信息输入的准确性、在相对安静的环境中,对于I人来说不好意思开口,不适合在公共场所中使用。其次投影+手势交互形式,虽然形式很新颖,但在手掌投屏,其清晰度、可见度和内容展示的丰富度,都不如显示屏。

第二,虽然AI PIN自建了COSMOS操作系统~~,并且能够让用户在Humane.center中管理和上传与自己相关的数据~~,但该系统不支持接入第三方应用程序APP,所以无法构建生态应用,导致在智能手机中的数据迁移成本过高。

三、TAB-AITab AI由一位名叫Avi Schiffmann的哈佛大学生开发。

它是一款可穿戴的AI项链,目前的产品样式是一个圆形的装置,内置通过麦克风、蓝牙和电池,可持续运行 30 小时、全天候、不间断地记录周围的对话。

1. 产品设计理念AVI在做这款产品时,他认为穿戴设备只是作为一个附属物,最好是让使用者几乎感觉不到它的存在,所以硬件设备只需要能够持续运行、随时可用即可,无需有复杂交互方式。

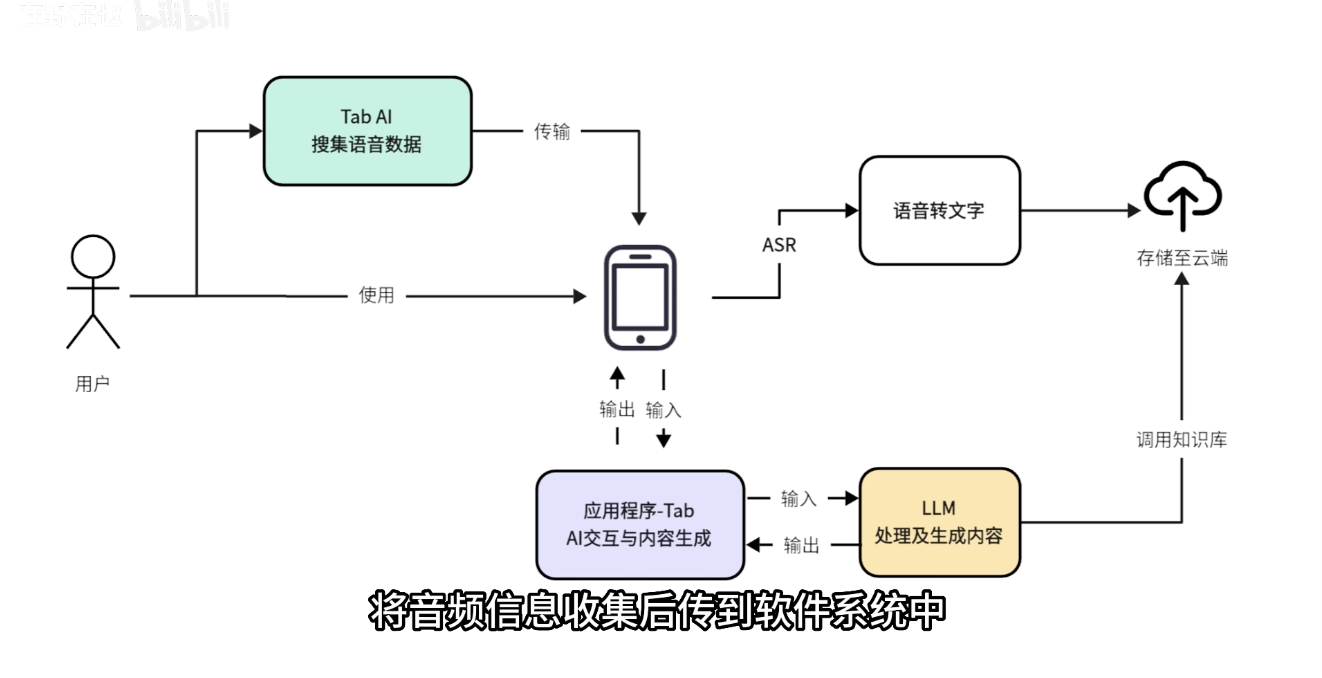

2. 硬件方面在产品的硬件设计上,最重要的三个硬件装置就是麦克风、蓝牙和电池,项链仅仅作为语音信息收集端,将音频收集后,传到软件系统中,进行音频转文字的处理,处理后的文字内容存储在云端服务器中。

一方面作为AI的知识库,可以被AI调用,让AI更懂用户。

另一方面,可以将文本传给大模型进行内容分析,比如个人的情感分析 或者 心理健康状态分析等等。

用户通过在手机应用程序的中与AI进行交流,交互的方式类似于移动端的ChatGPT,支持语音和文本的输入,支持多轮沟通。

所以Tab AI通过获取用户日常的语音数据,了解了用户整个生活背景的上下文,能够输出专属于我的内容。

我们沿着这个基础上做更近一步的假设。

除了在搜集音频外,Tab AI若能够近一步的做出行为规划,那将是一件更酷的事情。

比如一场会议结束后,AI通过搜集到的音频内容,自动生成会议纪要以及待办事情。

再比如我们日常交流观点时,AI能够获取我过往的思考,并与当前讨论内容进行结合,从而帮助我们形成知识的连接。每一个富有创新的想法时,就是在一次又一次的思维碰撞与连接中产生的。

结尾好啦~咱们分别介绍三款消费级AI设备:Rabbit-R1、AI PIN、Tab AI

你更喜欢哪一款呢?

随着时间的推移,AI必将成为我们日常生活中的合作伙伴、助理、甚至是懂你的朋友,它可能以具身机器人的形态出现,也可能以日常穿戴配件的方式融入我们的生活,无论以什么形式,我们都将迎来一个更加智能、便捷、高效的美好生活。

感谢你的观看,咱们下期再见。

作者:在野在也,公众号:在野在也